Search Live è arrivato ufficialmente anche in Italia, insieme a tutti gli altri Paesi e territori in cui è già disponibile AI Mode, la modalità di ricerca più avanzata di Google basata sull’intelligenza artificiale. Con questa espansione globale, Google porta nella Ricerca una nuova interfaccia conversazionale che unisce voce, contesto visivo, interazione in tempo reale e link al web, rendendo l’esperienza molto più simile a un dialogo naturale che a una semplice sequenza di query digitate. Secondo l’annuncio ufficiale di Google, il rollout riguarda oltre 200 Paesi e territori, compresa l’Italia, e permette alle persone di usare Search Live sia con la voce sia tramite la fotocamera dello smartphone.

Per capire davvero la portata di questa novità bisogna partire da un punto fondamentale: Search Live non è soltanto una funzione vocale in più, ma un’estensione concreta della trasformazione di Google Search in una piattaforma sempre più multimodale, capace di comprendere linguaggio naturale, immagini, contesto e follow-up complessi. Google descrive AI Mode come la sua esperienza di ricerca alimentata dall’AI più potente, progettata per rispondere a domande articolate, ragionare su più sottoargomenti e offrire approfondimenti tramite link utili al web. Search Live si inserisce proprio in questa visione: non sostituisce la ricerca tradizionale, ma la rende più dialogica, più fluida e più vicina al modo in cui le persone pensano e fanno domande nella vita reale.

In pratica, l’utente non deve più “scrivere bene per farsi capire dal motore di ricerca”. Può parlare come parlerebbe con una persona, fare una domanda iniziale, ascoltare la risposta vocale generata dall’AI e poi continuare con ulteriori richieste, chiarimenti o cambi di direzione. Questo aspetto è centrale, perché uno dei limiti storici della ricerca sul web è sempre stato l’attrito tra ciò che si vuole sapere e il modo in cui si formula la domanda. Con Search Live, Google tenta di ridurre proprio quell’attrito: il punto non è solo ricevere una risposta, ma poter costruire una conversazione di ricerca, passo dopo passo, mantenendo il contesto tra un intervento e l’altro.

Dal punto di vista dell’utilizzo, il funzionamento è volutamente semplice. Basta aprire l’app Google su Android o iOS, toccare l’icona “Live” sotto la barra di ricerca e iniziare a parlare. A quel punto Search Live restituisce una risposta audio generata dall’intelligenza artificiale e mostra sullo schermo anche una serie di link web utili per approfondire, così da tenere agganciata l’esperienza alla rete aperta e alle fonti online. Dopo la prima risposta, si può continuare con domande successive senza dover ricominciare da zero, perché il sistema mantiene il filo della conversazione. È un passaggio molto importante nella storia della Ricerca Google: non più solo una lista di risultati, ma un’interazione dinamica, contestuale e progressiva.

Uno degli elementi più interessanti è che Search Live funziona anche in background. Questo significa che l’utente può continuare a parlare con la Ricerca mentre usa un’altra app sul telefono, oppure persino con lo schermo bloccato, senza interrompere il flusso della conversazione. In un contesto quotidiano, questa caratteristica cambia molto il modo in cui il servizio può essere usato: si può cercare mentre si cammina, mentre si consulta una chat, mentre si guarda una mail o mentre si confrontano informazioni in un’altra applicazione. Google specifica però anche un limite importante: quando Search Live è in background, non è possibile condividere la fotocamera. La parte visuale, quindi, resta disponibile quando si è nell’interfaccia attiva della funzione, mentre la conversazione vocale continua a funzionare anche fuori dall’app.

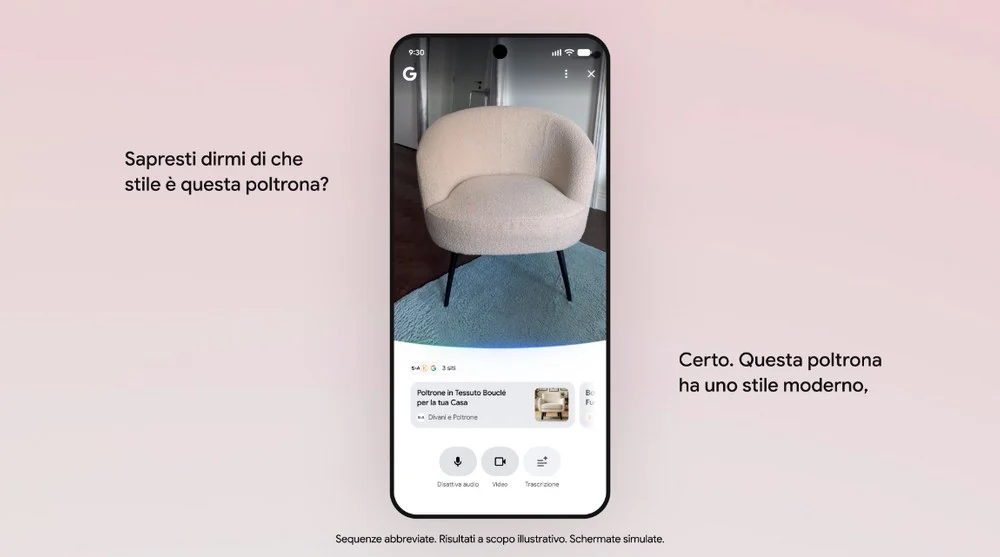

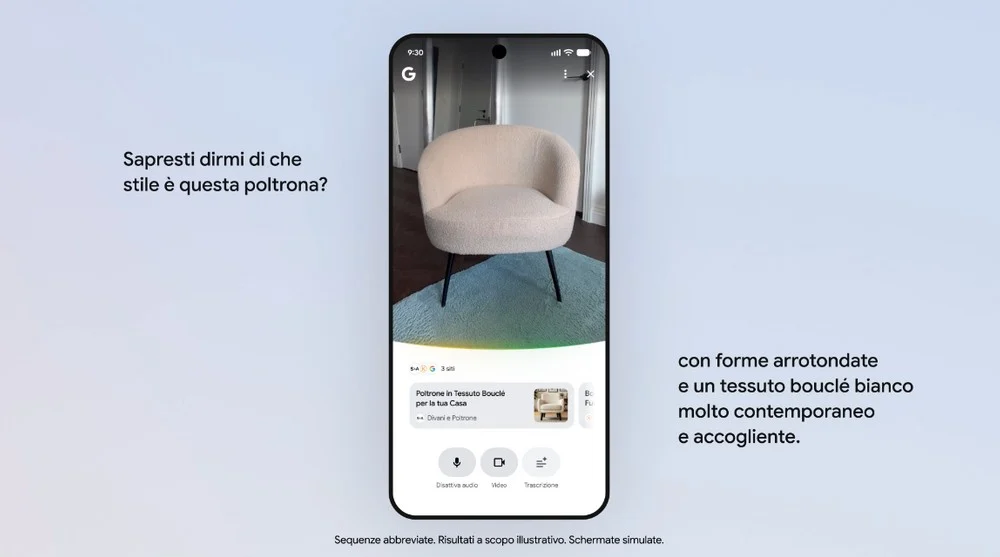

Ed è proprio la componente visiva a rendere Search Live qualcosa di più di un semplice assistente vocale. La fotocamera dello smartphone può essere usata per mostrare a Google ciò che abbiamo davanti, così da porre domande su oggetti, luoghi, monumenti, prodotti, dettagli tecnici o situazioni quotidiane che richiedono contesto visivo. In altre parole, non si descrive soltanto un problema: lo si mostra direttamente. Questo rende il sistema particolarmente utile in tutti quei casi in cui una spiegazione a parole sarebbe scomoda, incompleta o imprecisa. Se ad esempio si sta osservando un oggetto sconosciuto, una pianta, un elettrodomestico, un elemento architettonico o un’opera d’arte, si può inquadrare la scena e chiedere spiegazioni contestuali. Google conferma inoltre che è possibile avviare Search Live anche direttamente da Google Lens, toccando il pulsante “Live” nella parte bassa dello schermo.

Questa integrazione con Lens è strategica, perché collega due mondi che fino a poco tempo fa erano separati: da una parte la ricerca visuale, dall’altra la ricerca conversazionale. Lens era già lo strumento con cui Google permetteva di cercare “quello che si vede”; Search Live aggiunge la possibilità di parlare in tempo reale di ciò che si sta vedendo, creando una forma di interazione molto più naturale. Non si tratta più di scattare una foto, aspettare un riconoscimento e leggere risultati statici. Ora si può dire, per esempio: “Che cos’è questo?”, “A cosa serve?”, “Perché ha questa forma?”, “Come si usa?”, “Ci sono alternative migliori?”, “È un oggetto raro o comune?”. Il sistema non offre solo un’etichetta, ma cerca di inserire ciò che vede in un contesto esplicativo più ampio.

Alla base di questa evoluzione c’è Gemini 3.1 Flash Live, il nuovo modello audio-to-audio annunciato da Google il 26 marzo 2026 e descritto come un modello a bassa latenza, ottimizzato per il dialogo in tempo reale e per le applicazioni vocali “voice-first”. Secondo la documentazione ufficiale per sviluppatori, Gemini 3.1 Flash Live è pensato per gestire interazioni multimodali in cui input e output possono includere testo, immagini, audio e video, con particolare attenzione alla fluidità del dialogo, alla precisione e alla comprensione del contesto. Google lo presenta come il motore che rende le conversazioni di Search Live più naturali, più reattive e più affidabili.

Un dato particolarmente significativo riguarda la lingua. Google afferma che il nuovo modello è intrinsecamente multilingue e, nella comunicazione rivolta agli sviluppatori, parla di supporto a oltre 90 lingue per conversazioni multimodali in tempo reale. Questo punto è cruciale per il mercato italiano e, più in generale, per l’espansione fuori dagli Stati Uniti. La qualità delle interazioni vocali non dipende solo dalla capacità di “tradurre” le risposte, ma dalla possibilità di capire sfumature, follow-up, interruzioni e cambi di contesto in lingue diverse dall’inglese. Il fatto che Search Live arrivi in Italia insieme al rollout globale è quindi molto più di una semplice estensione geografica: è il segnale che Google ritiene matura la propria infrastruttura linguistica per una vera esperienza internazionale.

Google insiste anche su un altro concetto: la naturalezza della conversazione. Nella nuova generazione di modelli audio, il focus non è solo “parlare e rispondere”, ma gestire il ritmo del dialogo, interrompersi quando l’utente vuole intervenire, recepire meglio il contesto e mantenere coerenza nei turni di conversazione. Le pagine di supporto di Search Live spiegano infatti che l’utente può interrompere la risposta in corso, aggiungere dettagli, porre una nuova domanda o cambiare argomento. Questo comportamento è molto più vicino a una conversazione umana che a un comando vocale tradizionale. È una differenza apparentemente piccola, ma in realtà decisiva: quando una tecnologia conversazionale consente di entrare, uscire, correggere e reindirizzare il dialogo senza fratture, diventa davvero utilizzabile nella vita di tutti i giorni.

C’è poi il rapporto con AI Mode, che è il vero contenitore strategico di tutte queste novità. AI Mode è stato introdotto inizialmente come esperienza sperimentale e successivamente esteso a sempre più Paesi e lingue. Google lo descrive come una modalità capace di affrontare query più complesse attraverso una tecnica chiamata query fan-out, cioè la scomposizione della domanda in sottoargomenti e l’esecuzione simultanea di più ricerche, per poi sintetizzare e collegare i risultati in una risposta più ricca. Search Live eredita questo impianto, ma vi aggiunge immediatezza vocale e interazione visuale. In altre parole, AI Mode ragiona, mentre Search Live rende quel ragionamento conversabile in tempo reale.

Questa evoluzione va letta dentro una traiettoria più ampia. Già al Google I/O 2025 l’azienda aveva annunciato l’arrivo delle capacità “live” derivate da Project Astra all’interno della Ricerca, spiegando che con Search Live sarebbe stato possibile parlare con Search in tempo reale su ciò che si vede attraverso la fotocamera. Quello che allora era presentato come sviluppo imminente è oggi una realtà concreta e distribuita su vasta scala. È un passaggio significativo perché mostra come Google stia cercando di trasferire nell’esperienza quotidiana del motore di ricerca alcune delle capacità più ambiziose mostrate nei prototipi AI degli ultimi anni: comprensione multimodale, memoria di contesto, voce naturale e supporto operativo in tempo reale.

Per gli utenti italiani, l’arrivo di Search Live assume un significato ancora più forte se lo si collega al percorso recente di Google Search nel nostro Paese. AI Mode era arrivato in Italia nell’ottobre 2025, con supporto all’italiano e ad altre nuove lingue, come parte di un’espansione che aveva portato la funzione in quasi 50 nuovi Paesi e territori. Oggi Search Live rappresenta il passaggio successivo di quella stessa strategia: dopo aver reso la ricerca AI disponibile in italiano, Google porta nel nostro mercato anche la sua forma più dialogica e immersiva. L’Italia non riceve dunque una funzione isolata, ma entra pienamente nell’ecosistema globale della nuova Ricerca Google basata sull’AI.

Un altro elemento da non sottovalutare è il legame tra Search Live e la cronologia della Ricerca. Google spiega chiaramente che, per riprendere conversazioni precedenti e ottenere un’esperienza più continua, è necessario avere attivata la cronologia tramite Attività web e app. Senza questa impostazione, AI Mode resta utilizzabile, ma non permette di riprendere da dove si era interrotto il dialogo in precedenza. Questo dettaglio ha almeno due implicazioni. La prima è pratica: la continuità conversazionale non è automatica per tutti, ma dipende dalle impostazioni dell’account. La seconda è culturale: la nuova ricerca AI non è solo un motore che risponde qui e ora, ma punta a diventare uno spazio di interazione persistente, in cui il filo di ciò che si stava esplorando può essere recuperato anche dopo una pausa.

Naturalmente, questa continuità riporta al centro anche il tema della fiducia. Più una piattaforma di ricerca diventa conversazionale, più gli utenti si aspettano che sappia mantenere il contesto e ricordare ciò che è stato detto. Ma allo stesso tempo cresce la sensibilità verso il trattamento dei dati, la registrazione delle attività e la gestione delle preferenze personali. Google, nelle sue pagine di supporto, collega esplicitamente la ripresa delle conversazioni alla cronologia, e mette a disposizione controlli relativi all’Attività web e app, incluse le impostazioni che riguardano le attività vocali e audio. Questo non elimina i dubbi, ma chiarisce almeno un punto: la memoria della conversazione è una funzione che richiede un consenso e una configurazione specifica, non una caratteristica “sempre attiva” indipendente dalle scelte dell’utente.

Sul piano pratico, Search Live può rivelarsi utile in molti contesti quotidiani: per capire subito ciò che si ha davanti, risolvere dubbi pratici, ottenere informazioni su monumenti o luoghi e, più in generale, per chi trova più naturale parlare e mostrare invece di digitare. La combinazione tra voce, fotocamera e ricerca contestuale rende l’esperienza più immediata e naturale.

Detto questo, Search Live non elimina i limiti dell’intelligenza artificiale. Le risposte possono contenere errori, soprattutto quando il sistema deve interpretare voce, immagini e contesto in tempo reale. Per questo Google continua a integrare link web di approfondimento, così da mantenere il collegamento con fonti verificabili e contenuti originali.

Ed è proprio questo uno degli aspetti più rilevanti della strategia di Google: usare l’AI per facilitare l’accesso al web, non per sostituirlo. Search Live punta infatti a guidare l’utente verso informazioni pertinenti, lasciando comunque spazio all’esplorazione delle fonti.

C’è anche un aspetto strategico evidente: Google sta portando la Ricerca verso un modello sempre più conversazionale e multimodale, per restare competitiva in un mercato in cui la voce e l’interazione in tempo reale stanno diventando centrali. In questo percorso, Gemini 3.1 Flash Live rappresenta il motore tecnico che rende possibili risposte più rapide, naturali e multilingue.

In prospettiva, Search Live appare come un ulteriore passo verso una Ricerca sempre più continua, fluida e integrata con gli altri strumenti AI di Google. Per l’utente, il vantaggio è semplice: usare la Ricerca in modo più spontaneo, soprattutto quando scrivere è scomodo o quando serve un aiuto immediato su ciò che si sta osservando.

In definitiva, l’arrivo di Search Live in Italia conferma l’evoluzione della Ricerca Google verso un’esperienza più umana, visiva e interattiva. La voce aiuta a chiedere, la fotocamera aiuta a mostrare, i link aiutano a verificare: ed è proprio in questo equilibrio che la nuova funzione trova il suo vero valore.